AIのイノベーション促進とリスクへの対応の両立を図る

AIがもたらすリスクにも対処しつつ、AIに関する研究開発や社会実装を推進することを主な目的とした「人工知能関連技術の研究開発及び活用の推進に関する法律」(以下「AI法」)が2025年5月28日に国会で成立し、6月4日に公布された。 この法律は、日本において初めてAIに特化した法律であり、日本における今後のAI政策の根幹となる基本法的な位置づけを有するものである。

日本政府はこれまで、AIを包括的に規制する法律を制定する方針はとらず、既存の法令と拘束力のないガイダンス等のソフトローによって対処する方針をとってきた。一方、この数年で世界各国においてはAIのもたらす弊害に対処するため、規制法の制定が進んできた。例えば、EUにおいては、AI ActというAI規制法が成立し、事業者に厳格な義務を課し、違反した場合には非常に高額な制裁金を定めている。こうした世界の規制の動きなども踏まえて、AI戦略会議及びAI制度研究会を中心として、国際的な競争力を維持しつつ、AIのもたらす弊害をどのように対処していくためにどのような法制度をとるべきなのかが継続して検討されてきた。そのような議論のなかで、2024年4月19日には、AI開発者、AI提供者、AI利用者それぞれの留意点をまとめた「AI事業者ガイドライン(第1.0版)」が公表された。同ガイドラインに拘束力はなく、あくまで民間企業における自主的な取組みをサポートするものである。

今回、成立したAI法は、AI戦略会議及びAI制度研究会が、事業者や有識者、自治体などの関係者からヒアリング等を行った結果を踏まえ、AIのイノベーション促進とリスクへの対応の両立を図ることを目的に、法制度化がなされたものである。法制度化の背景には、日本がAIの研究開発面で、米国などの他国に後れを取っている状況があり、また、活用の面においてもAIサービスの利用率が著しく低迷していることが指摘されている。AI法の主旨は、EUのAI Actのように事業者に重い義務を課すものではなく、日本の国際的な競争力を維持・向上させる点に、よりフォーカスが置かれているものといえる。

AI法の特徴とは?―メインは国を対象とした基本法的な法律

では、AI法は、具体的にどのような法制度を導入したのか? AI法は、AI関連技術の研究開発及び活用の推進について、基本理念や責務、基本的な施策等を定めている。AI法は、国や地方公共団体を対象とした基本法的な性質の規定が多い。過度な規制によるイノベーションの阻害を避け、AI分野での国際競争力を高めることを重視しており、民間事業者に対して課された義務は限定的で、罰則も規定されていない。

AI法は、第一章「総則」、第二章「基本的施策」、第三章「人工知能基本計画」、第四章「人工知能戦略本部」の全四章から構成される。このうち、第一章の総則には一部民間事業者が関係する規定も含まれているが、第二章から第四章はいずれも対象は国や政府となっている。

政府は、AI法に定められた基本理念にのっとって、「人工知能基本計画」を定め、同計画に基づき、人工知能の研究開発や推進などの施策が定められることとされている。この基本計画が、今後の日本のAI政策の方向性を示す重要な指針となる。

さらに、AI法に基づいてAI関連の施策を総合的にかつ計画的に推進するための司令塔的な政府内組織として、内閣に「人工知能戦略本部」が設置される。この人工知能戦略本部が、上記の人工知能基本計画の案の作成や実施に関する事務を行い、また、AI関係の重要な施策を企画・立案するとされている。したがって、今後日本のAI政策の舵をとっていくのは、この人工知能戦略本部ということになる。

また、国は、AIの研究開発・活用の動向に関する情報収集や、AIの不正な目的又は不適切な方法による研究開発、利用にともなって国民の権利利益の侵害が生じた事案について調査・研究を行い、その結果に基づいて研究開発機関、活用事業者などに対して、指導、助言、情報の提供その他の必要な措置を講ずることができる仕組みが規定されている。例えば、AIの悪用による犯罪や個人情報の漏えい、著作権の侵害、ディープフェイクによる権利侵害などのリスクにも対応するため、必要な指導等を行うことが想定される。

「第7条」AI法における民間企業の義務

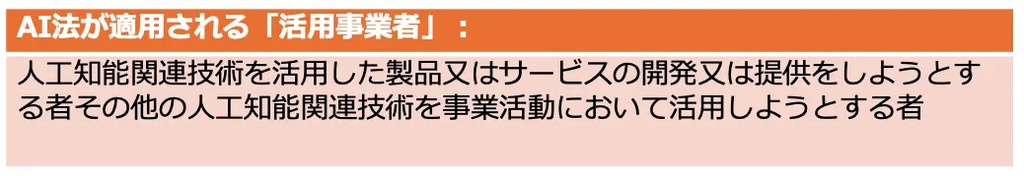

AI法において直接的に民間企業に対して義務を規定している主な条項が「第7条」である。第7条は、人工知能関連技術を活用した製品又はサービスの開発又は提供をしようとする者その他の人工知能関連技術を事業活動において活用しようとする者を「活用事業者」と定義し、活用事業者は、基本理念にのっとり、①自ら積極的な人工知能関連技術の活用により事業活動の効率化及び高度化並びに新産業の創出に努めるとともに、②国が実施する施策及び地方公共団体が実施する施策に協力しなければならないとしている。活用事業者の定義は、広く実装した情報処理システムを提供するような事業者などはこの活用事業者に含まれ、また、既に活用している事業者だけでなく、これから活用しようとする事業者も含まれる。

この活用事業者における①事業活動の効率化及び高度化並びに新産業の創出に努める義務、②国・地方公共団体の施策に協力する義務は、非常に抽象的な規定である。また、AI法においては違反した場合の罰則などは定められていない。もっとも、第16条では、政府がAIの研究開発や活用の動向、不適切な利用事例などを調査し、必要に応じて事業者に対して指導・助言・情報提供を行うことができるとされている。

このように、AI法は民間企業に対して直接的な規制や罰則を科すものではなく、現時点で直ちに民間事業者において具体的なアクションを義務付けるものではない。とはいえ、今後、国・地方公共団体の施策の内容に関して、調査の協力要請や指導・助言に対して適切な対応を行っていく必要があることが想定される。

民間企業はどのように対応していけばよいのか

上述のように、AI法における民間企業の義務は非常に抽象的で、限定的である。すなわち、活用事業者の主な義務としては、国及び地方公共団体が実施するAI関係の施策について「協力」する義務のみであって、現時点でAI法を遵守するためだけに何らかのアクションをとることが直接義務付けられているわけではない。

しかしながら、日本においては、AIに関する個別のリスクや分野ごとの規制は、引き続き既存の法律(個人情報保護法、著作権法、不正競争防止法、製造物責任法、民法、刑法など)が適用される。例えば、AIを実装したサービスの提供にあたって、個人データの漏洩のインシデントが発生すれば、個人情報保護違反が問われる可能性があり、また、著作権を侵害するようなサービスを提供した場合には、著作権法に従って損害賠償等が請求される可能性がある。

したがって、新しいAI法対応のためではなくとも、AIの利用にあたってコンプライアンスリスクを低減するため、AIガバナンスの組織体制を整備することが重要になる。企業はまず、自社のAI活用がどの法令に関係するかを整理したうえで、AIの開発・運用・活用に関する社内ガバナンス体制やリスク管理体制を整備することが必要であり、また、AIの適切な活用には、従業員のAIリテラシー向上も不可欠だ。AI倫理や透明性、説明責任、データ管理、セキュリティ対策などについて、社内ポリシーの整備等を通じて明確化すること、また、AI倫理、リスク管理、データの取り扱いなどについて、社内教育や研修を実施し、組織全体での意識醸成を図ることも必要といえる。

今後の展望と企業へのアドバイス

AI法は、現時点ではAIの研究開発・利活用を「推進」することを重視した枠組みであり、企業に対する直接的な罰則は存在しない。もっとも、AI法は、今後策定される「人工知能基本計画」や、既存の「AI事業者ガイドライン」などの法的強制力はないが社会規範として対応すべきソフトローと連動して運用されることが想定される。したがって、企業としては、こうした政府の基本計画やガイドライン等を漏らさずフォローすることが重要である。また、AI法の趣旨を踏まえつつ、AIガバナンス体制の整備、リスク管理、既存法令のコンプライアン体制、社内教育の強化など、先手を打った対応が求められる。特に、AIに関わるインシデントなどの発生により、社会的影響やリスクが顕在化した場合には、迅速かつ誠実な対応が企業価値の維持・向上につながる。そうした非常時の対応には、平常時の準備が欠かせない。

今後も、政府から公表される基本計画や関連ガイドライン、国際的な規制の進展を注視し、柔軟かつ積極的なAI活用とリスク管理の両立を目指すことが、企業にとって重要な経営課題となる。リスクについては決して無視をすべきではないものの、過度に恐れていては、グローバルな市場から後れをとってしまう場合もある。競争力を上げていくためにも、適切なリスク評価を行い、必要な場合には適切な低減措置をとりつつも、事業への積極的なAIの活用が求められる。